سیاستهای اخلاقی هوش مصنوعی

مقدمه

هوش مصنوعی (AI) به عنوان یکی از تحولات اساسی در دنیای فناوری، تأثیر عمیقی بر تصمیمگیریهای تجاری و توسعه فناوری داشته است. مهمترین جنبه این تحول، مسأله اخلاقی پیرامون پیادهسازی هوش مصنوعی است که امروز بیش از پیش اهمیت یافته است. سیاستهای اخلاقی هوش مصنوعی نه تنها به منظور توسعه فناوریهای مسئولانه اجرا میشوند، بلکه بهعنوان یک ابزار کلیدی در توسعه سیاستهای کسبوکار و حاکمیت نیز تلقی میشوند. در این مقاله به بررسی روندها، پیشزمینه، و آینده این سیاستها خواهیم پرداخت.

پیشزمینه

نگرانیهای عمومی درباره هوش مصنوعی تاریخچهای طولانی دارد. از ابتدای ظهور این فناوری، سؤالهایی درباره تأثیر آن بر مشاغل، حریم خصوصی، و عدالت اجتماعی مطرح شده است. براساس آمارها، 71% از آمریکاییها نگران هستند که هوش مصنوعی بهطور دائمی بسیاری از مشاغل را از بین ببرد و 67% معتقدند که عواقب هوش مصنوعی فراتر از کنترل انسانی خواهد بود. این نگرانیها نه تنها بر سیاستهای اخلاقی تأثیر گذاشته، بلکه موجب تقاضای عمومی برای قوانین سختگیرانه و حاکمیت مسئولانه بر فناوریهای نوین شده است (منبع).

روند

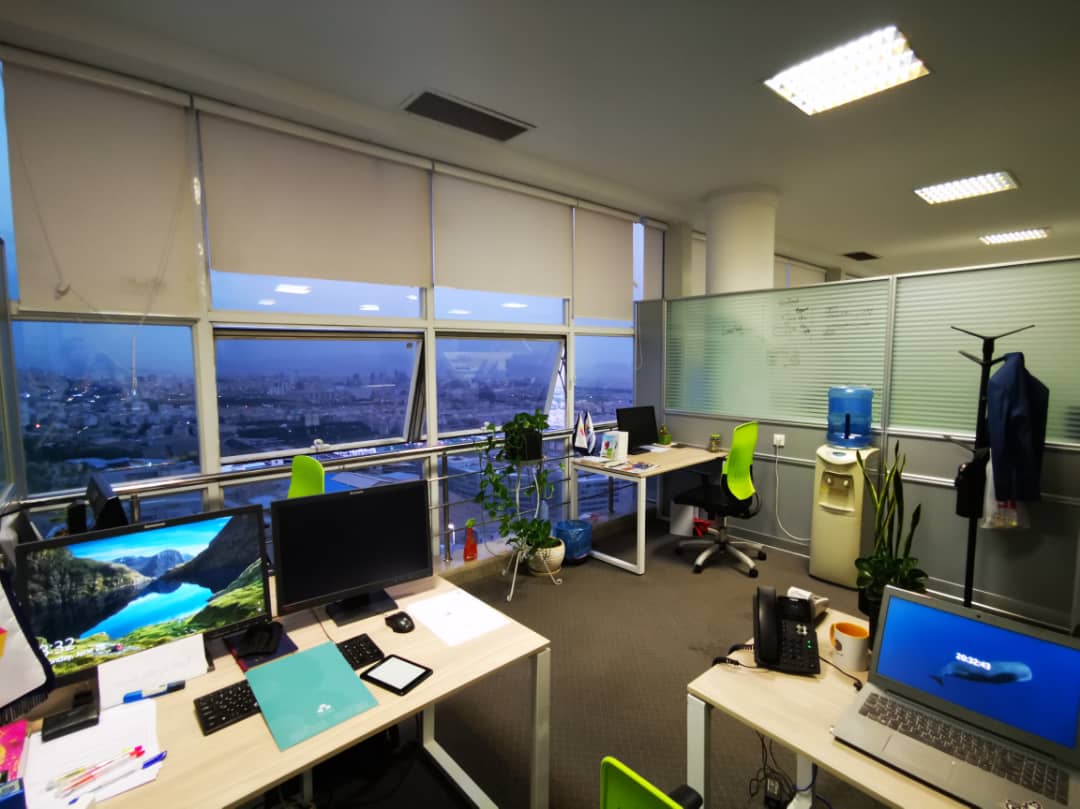

در سالهای اخیر، پذیرش فناوریهای هوش مصنوعی در بخشهای مختلف اقتصاد، به ویژه در کسبوکارهای کوچک و متوسط (SME) افزایش یافته است. این روند سبب تغییرات عمدهای در شیوههای کاری و تعاملات انسانی شده است. بهعنوان مثالی، تصور کنید که یک مغازه کوچک با استفاده از هوش مصنوعی، رویکردی \”خودکار\” به مدیریت موجودی و خدمات مشتریان پیدا کرده است. این بهبودها منجر به افزایش کارایی و کاهش هزینهها خواهد شد، اما در عین حال، ممکن است نگرانیهایی درباره از بین رفتن مشاغل محلی را بوجود آورد.

با این حال، پذیرش گسترده فناوریهای هوش مصنوعی چالشهای جدیدی را نیز ایجاد کرده است. بهویژه در حاکمیت، مسائل مربوط به حریم خصوصی و مسئولیت قانونی مطرح میشوند. بسیاری از پژوهشگران بر این باورند که سیاستهای حکمرانی SME باید به گونهای طراحی شوند که ضمن حمایت از نوآوری، به نگرانیهای عمومی نسبت به پیامدهای اخلاقی هوش مصنوعی نیز توجه شوند.

بینش

درک واکنشهای عمومی نسبت به پیادهسازی هوش مصنوعی اخلاقی برای سیاستگذاران ضروری است. نظرسنجیها نشان میدهند که 55% از ساکنان کالیفرنیا بیشتر نگران از هیجان نسبت به هوش مصنوعی هستند، و 64% نگرانی اصلی آنها مربوط به محتواهای تولید شده با هوش مصنوعی مانند deepfake است (منبع). این نتایج نشان میدهند که سیاستگذاران باید به تقویت احساس امنیت عمومی بپردازند و به حالات کنترل و نظارت بر ابزارهای هوش مصنوعی توجه بیشتری کنند.

پیشبینی

با توجه به روندهای کنونی، آینده توسعه سیاستهای اخلاقی هوش مصنوعی با چالشهای متعدد مواجه است. ضرورت کشف راهکارهایی برای اجرا و نظارت مؤثر بر فناوریهای نوین، امری حیاتی خواهد بود. از جمله چالشها میتوان به عدم وجود استانداردهای بینالمللی و بومی در زمینه اخلاقی شدن هوش مصنوعی اشاره کرد. همچنین، باید بر یکپارچگی فناوریهای نوین و سیاستهای اجتماعی تأکید شود تا از نابرابریهای اجتماعی جلوگیری گردد.

فراخوان به اقدام

در پایان، همگان باید به اهمیت توسعه و پیادهسازی سیاستهای اخلاقی مؤثر در خصوص هوش مصنوعی آگاه شوند. سازمانها باید از طریق توسعه تکنیکهای مسئولانه و حاکمیت اخلاقی، ریسکهای ناشی از پیادهسازی تکنولوژیهای خودکار را مدیریت کنند. این اقدام نه تنها به افزایش اعتماد عمومی کمک خواهد کرد، بلکه به رشد پایدار و عادلانه فناوریهای نوین نیز خواهد انجامید.

با توجه به تحولات سریع در این زمینه، کسبوکارها باید همواره به وضعیت بازار و واکنشهای عمومی توجه داشته باشند و بهروزترین سیاستها را در دستور کار خود قرار دهند.