حفاظت از اسرار تجاری هوش مصنوعی: راهنمای جامع برای کسبوکارها

مقدمه: چرا حفاظت از اسرار تجاری هوش مصنوعی حیاتی است؟

در سالهای اخیر پروندههای مرتبط با افشای اطلاعات محرمانه در صنعت هوش مصنوعی افزایش یافتهاند؛ یکی از برجستهترین نمونهها پرونده XAI علیه کارمند سابق است که نشان میدهد حتی کارکنان با دسترسی داخلی میتوانند تهدیدی جدی برای سرمایهگذاریهای میلیاردی در تحقیق و توسعه باشند. همین نکته باعث شده تا بحث حفاظت از اسرار تجاری هوش مصنوعی به یکی از اولویتهای اصلی شرکتها تبدیل شود. منابع نشان میدهند که فناوریهای پیشرفتهای که در محصولات مانند Grok توسعه یافتهاند، نتیجهی سالها مهندسی و سرمایهگذاری سنگین هستند و از دست رفتن این اطلاعات میتواند زیانهای بزرگ و غیرقابل جبرانی به همراه داشته باشد (منبع: گزارش زومیت). https://www.zoomit.ir/business/447100-xai-sues-ex-employee-stealing-grok/

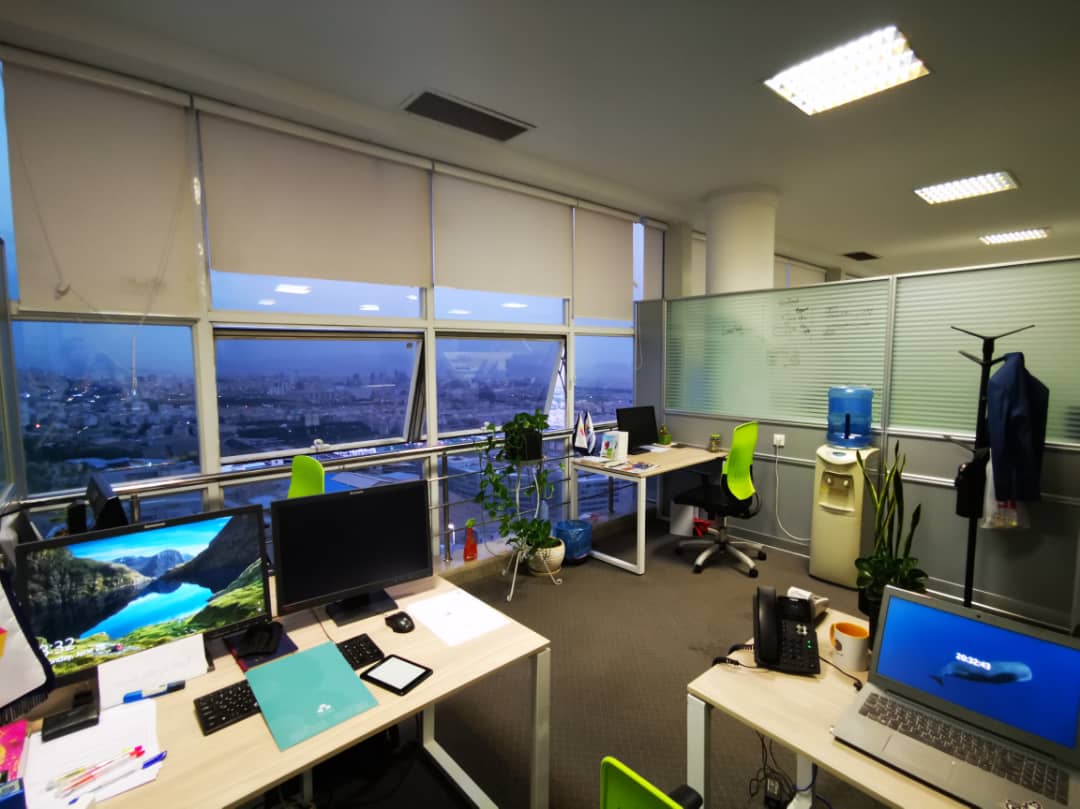

امنیت دادههای مراکز تماس (call center data security) و حفاظت از دادههای مشتریان (customer data protection) جزو حوزههایی هستند که در معرض مخاطرات ویژهای قرار دارند، چرا که دسترسیهای گسترده و تبادل مکرر اطلاعات میان کارکنان، چتباتها و سامانهها رخ میدهد. همانطور که یک کارخانه خودروسازی از «فرمول مخفی» برای تولید موتورهای برتر محافظت میکند، شرکتهای فناور نیز باید از مدلها، دادهها و روشهای آموزشی هوش مصنوعی مانند یک دارایی بسیار حساس محافظت کنند.

پیشبینی میشود در آینده نزدیک:

– شرکتها استانداردهای پروتکلهای امنیتی هوش مصنوعی را تقویت کنند.

– قراردادهای محرمانگی کارکنان (employee confidentiality agreements) بهصورت دقیقتر و با جریمههای مشخص تنظیم شوند.

– نظارت بر دسترسیهای داخلی و سیستمهای لاگینگ و تحلیل رفتاری افزایش یابد.

در این راهنما، به بررسی پیشینهی نمونههای سرقت، روندهای فعلی در امنیت دادههای مرکز تماس، راهکارهای حفاظت از چتباتها و اقدامات عملی برای تقویت حفاظت از اسرار تجاری هوش مصنوعی خواهیم پرداخت.

پیشینه: داستان سرقت اطلاعات Grok توسط XAI

پرونده قضایی XAI علیه Xuechen Li یکی از نمونههای شاخصی است که ماهیت پیچیده و محوری سرقت اسرار تجاری در صنعت هوش مصنوعی را نمایان میسازد. طبق گزارشها، این کارمند سابق اسنادی مربوط به توسعهی چتبات Grok را از لپتاپ سازمانی منتقل کرده و سپس فایلها را به دستگاههای شخصی آپلود کرده است؛ نه تنها انتقال انجام شد، بلکه فرد اقدام به پنهانسازی آثار کرده، فایلها را تغییر نام داده، فشرده کرده و تاریخچه مرورگر را پاک کرده است (منبع: زومیت). https://www.zoomit.ir/business/447100-xai-sues-ex-employee-stealing-grok/

این رفتار نمونهای از ترکیب روشهای فیزیکی و دیجیتال برای استخراج اطلاعات حساس است:

– کپیبرداری از اسناد و مدلها به دستگاههای شخصی یا سرویسهای ابری.

– استفاده از تکنیکهای فشردهسازی و تغییر نام برای دور زدن بررسیهای خودکار.

– حذف شواهد و پاکسازی تاریخچه برای پنهانسازی ردپا.

از منظر حقوقی، شرکت XAI درخواست کرده است که دسترسیهای شخص متهم محدود شود، تمامی مواد محرمانه بازیابی گردد و مانع از استخدام او در شرکتهای رقیب مانند OpenAI شود تا زمان بازگردانی اطلاعات. این رویداد نشان میدهد که حفاظت صرف از لایههای فنی کافی نیست؛ لازم است چارچوبهای قانونی و قراردادی نیز قوی و بازدارنده باشند.

مثال برای روشنتر شدن موضوع: تصور کنید یک نانوا فرمول خمیر مخصوص را که پس از سالها تجربه ابداع شده، به یک نفر کارکنان نشان میدهد و آن کارمند نسخهای از فرمول را با خود میبرد و در نانوایی دیگری استفاده میکند؛ در دنیای فناوری، این «فرمول» همان مدلهای آموزشی، دادههای با ارزش و پارامترهای بهینهسازی است. پیامآور این پرونده این است که ترکیب راهکارهای فناوری، حقوقی و فرهنگی سازمانی برای جلوگیری از تکرار چنین حوادثی ضروری است.

پیامدهای این نوع سرقتها در آینده میتواند شامل افزایش دعاوی قضایی، هزینههای گزاف برای بازیابی اطلاعات و الزام به اقدامات امنیتی جدید در سطح صنعت باشد. این پرونده هشداری است برای همه کسبوکارهایی که در زمینه هوش مصنوعی سرمایهگذاری میکنند تا حفاظت از مالکیت معنوی و اسرار تجاری را در صدر اولویتها قرار دهند.

روندهای فعلی در امنیت دادههای مرکز تماس

صنعت خدمات مشتری و مراکز تماس در دوران هوش مصنوعی دستخوش تغییرات اساسی شده است؛ چتباتها و سامانههای خودکار بخشی از جریان کار روزمره شدهاند و همین مسئله باعث شده تا بحث call center data security و customer data protection بهعنوان موضوعاتی حیاتی مطرح شوند. افزایش موارد سرقت مالکیت فکری در صنعت هوش مصنوعی همزمان با رقابت شدید برای جذب استعدادها، فضای امنیتی را پیچیدهتر کرده است. گزارشها حاکی از پیشنهادهای مالی بسیار بزرگ حتی تا حدود ۲۵۰ میلیون دلار برای جذب نیروی متخصص است که این شرایط میتواند انگیزههای بیشتری برای انتقال غیرقانونی اطلاعات ایجاد کند.

سه روند کلیدی فعلی:

– افزایش حملات داخلی و نشت اطلاعات به دلیل دسترسی گسترده کارکنان به دادهها و مدلها.

– رشد مهاجرت استعدادها میان شرکتها و در نتیجه افزایش احتمال انتقال غیرمجاز دانش فنی.

– توسعه ابزارهای نظارتی و تشخیص ناهنجاری برای شناسایی رفتارهای مشکوک در محیطهای کاری.

اهمیت پروتکلهای امنیتی هوش مصنوعی (AI security protocols) در این میان بیش از پیش مشخص میشود. سازمانها باید به سمت ساختارهای چندلایه حرکت کنند که شامل:

– کنترلهای دسترسی مبتنی بر نقش و نیاز واقعی به دادهها.

– رمزنگاری نقطه به نقطه برای ذخیره و انتقال دادههای حساس.

– سامانههای شناسایی و واکنش به نشت اطلاعات (DLP) و تحلیل لاگها برای کشف رفتارهای مشکوک.

آینده نزدیک احتمالاً شاهد استانداردسازی بیشتر در این حوزه خواهیم بود؛ نهادهای نظارتی و انجمنهای صنعتی ممکن است چارچوبهایی برای حفاظت از دادههای مراکز تماس وضع کنند که الزامآور باشد. همچنین پیشبینی میشود که تمایل به استفاده از زیرساختهای امنتر مانند محیطهای کار ایزوله (sandbox) برای توسعه مدلها و ادغام مکانیزمهای محافظتی در لایههای توسعه و تولید افزایش یابد.

در نهایت، همراستا کردن سیاستهای فنی با جنبههای حقوقی مانند موافقتنامههای محرمانگی کارکنان (employee confidentiality agreements) و جزئیات قراردادهای استخدامی، برای کاهش ریسکهای ناشی از انتقال دانش به رقبا حیاتی خواهد بود.

بینشهای تخصصی: محافظت از چتباتهای هوشمند

چتباتهای هوشمند و سامانههای مکالمهای امروز بخشی از تجربه مشتریان هستند و بسیاری از شرکتها فناوریهایی توسعه دادهاند که در برخی موارد از نمونههایی مانند ChatGPT فراتر نشان داده شدهاند. حفاظت از chatbot intellectual property و حفظ محرمانگی ساختارهای داخلی این سیستمها نیازمند ترکیبی از اقدامات فنی، حقوقی و سازمانی است.

عناصر کلیدی در محافظت از چتباتها:

– مدیریت نسخهها و کنترل دسترسی به کد و مدل: هر تغییر در مدل باید ثبت و با سیاستهای تغییر کنترل همسو شود.

– رمزنگاری دادههای آموزش و ذخیرهسازی امن پارامترها: حتی اگر دسترسی فیزیکی به سرورها بهدست آید، دادهها باید خوانا نباشند.

– اجرای لاگینگ و تحلیل رفتار: شناسایی الگوهای خارج از عرف در دانلود یا انتقال فایلها.

– قراردادهای محرمانگی کارکنان و محدودیتهای استخدامی: بستن راههای قانونی برای نقل و انتقال اطلاعات به رقبا.

یک قیاس روشنکننده: تصور کنید یک قلعه دارای چندین پل متحرک (پلهای دسترسی) است؛ برای محافظت از گنجینههای داخل، لازم است هر پل بهصورت دقیق کنترل و نگهبانی شود و هر فردی که وارد میشود تنها به محلهایی دسترسی داشته باشد که لازم دارد. چتباتها نیز مشابه همین قلعه هستند؛ لایههای دسترسی و نگهبانی باید بهدقت طراحی شوند.

برای حفاظت از دادههای مشتریان و جلوگیری از سوءاستفاده، باید از اصول زیر استفاده کرد:

– جداسازی دادههای آموزشی از دادههای عملیاتی شخصیسازیشده مشتری.

– آنومایز یا حذف اطلاعات شناساییپذیر پیش از استفاده در آموزش مدل.

– پیادهسازی پروتکلهای کنترل دسترسی دقیق و بازبینی دورهای آنان.

در حوزه حقوقی، موافقتنامههای محرمانگی کارکنان (employee confidentiality agreements) باید شامل مفاد صریح درباره مالکیت معنوی چتبات و مجازاتهای نقض شوند. همچنین مشورت با تیمهای حقوقی برای درج بندهای بازدارنده در قراردادهای خروج کارکنان و محدودیتهای استخدام در رقبا میتواند ریسک انتقال دانش را کاهش دهد.

پیشبینی میشود که در آینده نزدیک، ترکیبی از استانداردهای فنی و الزامهای قانونی جدید شکل بگیرد که حفاظت از مالکیت معنوی چتباتها را فراتر از قراردادهای سنتی کند؛ رویکردهایی مانند گواهی امنیتی برای مدلها و ارزیابیهای مستقل امنیتی در فرآیند عرضه محصول احتمالاً رواج یابند.

پیشبینی آینده: تحولات امنیتی در صنعت AI

صنعت هوش مصنوعی در مسیر بلوغ قرار دارد و با افزایش ارزش اقتصادی مدلها و دادهها، حفاظت از مالکیت معنوی به یک اولویت راهبردی تبدیل میشود. بر اساس روندهای فعلی و نمونههای قضایی مانند پرونده XAI، چند پیشبینی کلیدی وجود دارد:

1. افزایش پروندههای قضایی مربوط به جاسوسی شرکتی و نقض اسرار تجاری: شرکتها بیشتر به راهکارهای قضایی متوسل خواهند شد و قوانین مرتبط با حفاظت از اسرار تجاری و مالکیت معنوی تشدید میشوند. این روند میتواند منجر به ایجاد سوابق قضایی جدید قابل اتکا در این حوزه گردد.

2. توسعه استانداردهای جدید امنیتی برای هوش مصنوعی: نهادهای صنعتی و حکومتی در تلاش برای تعریف چارچوبهای مشخصی برای ارزیابی امنیت مدلها، مدیریت دادههای آموزشی و آزمایشهای نفوذ هستند. انتظار میرود استانداردهایی شبیه گواهیهای امنیتی برای مدلها ایجاد شود.

3. تمرکز روی حفاظت از دادههای مشتریان و شفافیت: مقررات حفظ حریم خصوصی و حفاظت از دادهها ممکن است شامل دستورالعملهای ویژه برای استفاده از دادههای مشتری در آموزش مدلها شوند. این امر اهمیت \”حفاظت از دادههای مشتریان\” را افزایش میدهد.

4. روی آوردن به معماریهای امن و «اعتماد صفر» (Zero Trust): برای کاهش ریسکهای ناشی از دسترسیهای داخلی، سازمانها به سمت معماریهایی حرکت خواهند کرد که هیچ دسترسی ثابت و مطمئنی را بدون تأیید چندمرحلهای نمیپذیرند؛ این شامل کنترل دقیق روی زیرساختهای مرکز تماس و سیستمهای توسعه است.

5. بازار خدمات محافظتی تخصصی: تقاضا برای خدمات مشاوره امنیت سایبری تخصصی در حوزه AI، ابزارهای DLP مخصوص مدلها، و راهکارهای رمزنگاری پارامتریک افزایش خواهد یافت.

نمونهای از پیامدهای احتمالی: شرکتها ممکن است بهجای ذخیره تمامی دادهها بهصورت متمرکز، از رویکردهایی مانند آموزش توزیعشده یا فدرِیتد استفاده کنند تا خطر نشت دادهها کاهش یابد. همچنین قراردادهای کاری با بندهای بازدارنده و محرمانگی پیچیدهتر و مکانیزمهای فنی برای جلوگیری از خروج غیرمجاز داده به دستگاههای شخصی گسترش خواهند یافت.

در مجموع، آینده امنیت در AI ترکیبی از استانداردهای حقوقی، پروتکلهای فنی پیشرفته و تغییر در فرهنگ سازمانی خواهد بود که بهخوبی نشان میدهد محافظت از اسرار تجاری دیگر صرفاً یک موضوع فنی نیست، بلکه راهبردی و چندوجهی است.

اقدام عملی: راهکارهای محافظت از اسرار تجاری شما

حفاظت از اسرار تجاری هوش مصنوعی نیازمند مجموعهای از اقدامات ترکیبی است که هم سطح فنی و هم جنبههای حقوقی و انسانی را پوشش دهد. در ادامه راهکارهای عملی و قابل اجرا برای کسبوکارها آورده شده است:

– تدوین و اجرای پروتکلهای امنیتی جامع برای هوش مصنوعی:

– تعریف سیاستهای دسترسی مبتنی بر کمترین امتیاز لازم (least privilege).

– پیادهسازی رمزنگاری برای دادههای در حال انتقال و ذخیرهشده.

– استفاده از محیطهای ایزوله برای آموزش و تست مدلها.

– اجرای موافقتنامههای محرمانگی با کارکنان (employee confidentiality agreements):

– درج بندهای مشخص درباره مالکیت معنوی، منع استفاده از اطلاعات پس از ترک سازمان و جریمههای نقض.

– الزام به اطلاعرسانی هرگونه پیشنهاد شغلی از رقبا و بررسی تضاد منافع.

– پیادهسازی سیستمهای نظارتی پیشرفته:

– راهکارهای DLP برای کشف و جلوگیری از انتقال غیرمجاز دادهها.

– مانیتورینگ رفتار کاربران و هشداردهی بر روی الگوهای غیرمعمول در دانلود یا انتقال فایل.

– کنترل و ثبت لاگهای دقیق برای قابلیت بازسازی حوادث.

– محافظت از مالکیت معنوی چتباتها (chatbot intellectual property):

– مدیریت نسخهها، کنترل کد و مدلها با ابزارهای SCM و ثبت تغییرات.

– آنونیمسازی دادههای حساس پیش از استفاده در آموزش و تست.

– اعمال محدودیتهای زمانی و قراردادی برای دسترسی به مدلها.

– تقویت امنیت در مراکز تماس (call center data security):

– جداسازی محیطهای تولیدی و توسعهای، و اعمال رمزنگاری برای مکالمات و رکوردها.

– آموزش مستمر کارکنان در زمینه رعایت حریم خصوصی و شناسایی تهدیدات داخلی.

– مشاوره با متخصصان امنیت سایبری و حقوقی:

– ارزیابی سالانه ریسکها و تستهای نفوذ اختصاصی برای سیستمهای AI.

– مشورت برای تدوین قراردادهای کاری و سیاستهای خروج اطلاعات.

– بهروزرسانی مستمر سیاستهای حفاظتی:

– بازنگری دورهای سیاستها با توجه به تغییرات فناوری و قوانین.

– بهکارگیری استانداردهای جدید و تطابق با چارچوبهای صنعتی.

جمعبندی و توصیه نهایی: حفاظت از اسرار تجاری هوش مصنوعی یک مسیر پویا است؛ مانند نگهداری از یک مزرعه حساس که نیاز به حصار، نگهبان و قوانین محلی دارد. ترکیب ابزارهای فنی، قراردادهای محکم و فرهنگ سازمانی آگاه میتواند از سرمایههای فکری شما محافظت کند و ریسکهایی مانند پروندههای قضایی یا از دست رفتن مزیت رقابتی را کاهش دهد. برای جزئیات بیشتر در مورد نمونههای واقعی و نکات حقوقی مرتبط با پروندههای اخیر میتوانید به گزارش زومیت درباره پرونده XAI مراجعه کنید. https://www.zoomit.ir/business/447100-xai-sues-ex-employee-stealing-grok/

مقالات مرتبط:

– گزارش پرونده XAI و سرقت اطلاعات Grok (زومیت): https://www.zoomit.ir/business/447100-xai-sues-ex-employee-stealing-grok/